CONSULTING

MCP: una tecnología que transforma el ciclo de vida del desarrollo de software industrial

Juan Manuel Silva Hidalgo

Consultor Smart Industry | Linkedin

Para quienes han usado la inteligencia artificial para crear algún tipo de contenido, no es un secreto que ésta puede cometer errores. Estas equivocaciones, conocidas comúnmente como “alucinaciones”, pueden ir desde pequeños errores de redacción hasta respuestas incorrectas que vuelven inútil, o incluso riesgoso, su uso.

En el desarrollo de software y durante la operación, esto es incluso más problemático. Un resultado erróneo no solo afecta la calidad del contenido, sino que puede traducirse en fallos funcionales, vulnerabilidades, integraciones defectuosas o malas decisiones técnicas (Lo hemos visto con la caída de múltiples sistemas). Por eso, a medida que se extiende el uso de la IA en el desarrollo de software, se vuelve indispensable tener mecanismos de control que le den un contexto valioso, límites claros y acceso controlado a los sistemas con los que interactúa. Aquí es donde entra en juego el Model Context Protocol (MCP), que tiene como finalidad estandarizar la interacción entre herramientas de IA con entornos de desarrollo reales, haciendo su uso más confiable mientras se mantienen sus beneficios.

En IDOM hemos impulsado la adopción de esta tecnología en nuestros procesos de desarrollo de software y en entornos de producción desplegados. En este artículo compartimos nuestra experiencia, los principales retos y los beneficios que hemos identificado hasta el momento.

El Model Context Protocol (MCP) permite integrar la inteligencia artificial en entornos reales de desarrollo de software de forma contextualizada, controlada y confiable, reduciendo riesgos y mejorando todo el ciclo de vida de las soluciones industriales

¿Qué es lo que ocurre actualmente? ¿Por qué la IA comete errores?

A pesar de que el uso de la AI se ha extendido cada vez más, actualmente solo aprovechamos una fracción de su verdadero potencial. Todavía existen muchos retos que deben superarse para pasar de una adopción parcial a una integración más profunda, útil y confiable en los procesos de desarrollo y de operación.

Uno de los principales problemas es el acceso al contexto real del proyecto. Hoy, la forma más común en la que interactuamos con las herramientas de IA, especialmente con los grandes modelos de lenguaje (LLMs), sigue siendo a través de interfaces de chat. Esto hace que el intercambio de información sea ineficiente y limite la capacidad de los modelos de IA para acceder a información crucial como la arquitectura del proyecto, las reglas del negocio, el acceso directo a los repositorios, a los tickets de trabajo, a las dependencias del sistema o el estado real de una tarea dentro del proyecto.

A esto se le suma un segundo desafío: La gobernanza y el control. En muchos entornos de producción todavía no están claramente definidos los límites sobre la información a la que la IA puede acceder, las herramientas que puede utilizar o el tipo de acciones que debería estar autorizada a ejecutar. Esta falta de control no solo reduce la confianza en su uso, sino que también introduce riesgos asociados a seguridad, trazabilidad y operación.

MCP como estándar de integración de la IA en entornos reales

Aquí es donde entra MCP, una tecnología para estandarizar la forma en la que los modelos de IA se conectan con sistemas, herramientas y fuentes de información del entorno real. Su propósito no es solo mejorar la interacción con la IA, sino hacerla más útil, contextualizada y controlada tanto en los procesos de desarrollo de software como en la operación diaria de las aplicaciones y soluciones ya desplegadas en producción.

Su funcionamiento se basa en una arquitectura host-client-server. El “host” es el entorno principal en el que ocurre la interacción, como un IDE, un editor o una interfaz conversacional. Dentro del “host”, operan los clientes, que son los componentes encargados de comunicarse con los servidores MCP. Por otra parte, los servidores, son los sistemas que exponen capacidades concretas del modelo, como el acceso a información del proyecto, instrucciones reutilizables o funciones ejecutables.

Para lograrlo, MCP organiza esta interacción en tres tipos principales de capacidades. Los “Prompts”, que funcionan como plantillas o instrucciones para guiar el modelo en tareas concretas. “Resources”, corresponden a la información relevante del proyecto a la que el modelo puede acceder, como archivos, documentación, esquemas o datos. Finalmente, las “Tools”, que son funciones que el modelo puede ejecutar para realizar una acción especifica dentro de un entorno controlado.

El valor de esta estructura no se limita a acelerar actividades de desarrollo. También permite que la IA participe de manera más útil en tareas de operación cotidiana, como la consulta de documentación técnica, el análisis de incidentes, la validación de configuraciones, la interpretación de logs, el soporte a usuarios o la actualización de información asociada a una solución en funcionamiento. De esta forma, MCP no solo mejora la construcción de software, sino también su seguimiento, mantenimiento y evolución en entornos reales.

Toda esta información es útil, pero sigue siendo un poco abstracta, su valor se entiende mucho mejor en la práctica. Por ello, describiremos el proceso que seguimos para utilizar esta tecnología en nuestros flujos de desarrollo y cuales fueron los resultados que obtuvimos de su adopción.

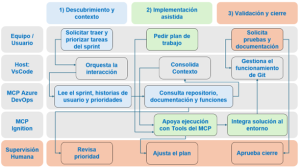

Prueba de concepto: MCP Azure devops y MCP open source Ignition

El primer paso en la adopción de esta tecnología fue identificar qué herramientas utilizábamos, cómo las estábamos usando y en qué puntos existía margen de mejora. En nuestro caso, Azure DevOps ya ocupaba un papel central en la gestión de buena parte del ciclo de vida del desarrollo de software, por lo que resultaba natural comenzar allí. A partir de ese diagnóstico, analizamos qué capacidades de inteligencia artificial ya estaban disponibles o podían integrarse dentro de este entorno. Encontramos entonces una ventaja importante: Azure DevOps ya contaba con un servidor MCP funcional y de fácil integración con nuestro entorno de desarrollo en Visual Studio Code, lo que nos permitió avanzar rápidamente en una primera prueba de concepto.

La conexión con el servidor fue sencilla: Bastó con agregar la configuración de MCP en Visual Studio Code e iniciar sesión con nuestras credenciales. Con ello, pudimos acceder de forma controlada a la información relevante y autorizada del proyecto. A partir de instrucciones en lenguaje natural, fue posible solicitar la identificación de todas las tareas asociadas al sprint actual y las clasificamos de acuerdo con su importancia. Posteriormente, evaluamos la tarea más prioritaria de acuerdo con el contenido del repositorio y evaluamos las funciones existentes que pudieran ser útiles para su resolución. Con esta única instrucción, la IA fue capaz de acceder a las historias de usuario, consultar documentación funcional y comprender tanto el contexto técnico como el de negocio.

Sobre esa base, le solicitamos construir un plan detallado de implementación que incluyera la revisión de patrones de diseño ya utilizados, las APIs disponibles y las librerías empleadas en el proyecto. Una vez generado el plan de trabajo, revisamos sus puntos principales, refinamos algunos aspectos e integramos las tools del MCP Open Source de Ignition, una plataforma de desarrollo de software orientada a soluciones industriales, para apoyar la ejecución de la solución.

Con el nuevo código generado, le pedimos además incorporar un conjunto de pruebas y validaciones que permitieran verificar tanto el correcto funcionamiento de la solución propuesta como su integración con el resto del código existente. Finalmente, una vez aprobada la solución, se le solicitó generar la documentación correspondiente e integrarla con la ya existente, con el fin de mantenerla actualizada y alineada con el estado real del proyecto.

De esta forma, la prueba de concepto no solo mostró la capacidad de MCP para asistir tareas puntuales, sino también su potencial para acompañar varias etapas del ciclo de vida del desarrollo de software, desde la comprensión de requerimientos hasta la implementación, validación, documentación y gestión de cambios mediante ramas, commits, push y pull request, todo ello a partir de interacción en lenguaje natural y con supervisión humana.

Conclusiones: ¿Cómo se ve el futuro?

La experiencia obtenida muestra que MCP no solo representa una mejora técnica en la forma en que interactuamos con la inteligencia artificial, sino una nueva forma de integrarla en entornos reales de trabajo. Su capacidad para conectar modelos con contexto, herramientas y sistemas permite reducir fricciones, acelerar tareas, mejorar la calidad de las soluciones y aprovechar de manera más efectiva el conocimiento acumulado en los proyectos.

Sin embargo, su alcance va mucho más allá del desarrollo de nuevas funcionalidades. En el corto plazo, MCP puede fortalecer la operación de soluciones ya desplegadas al servir como apoyo en tareas como la revisión de incidencias, la consulta de información técnica o la asistencia en actividades de mantenimiento. A futuro, también podría dar lugar a aplicaciones más especializadas, como asistentes para la gestión de procesos industriales, capaces de acompañar a los equipos en la supervisión de operaciones, la interpretación de eventos de planta, el apoyo al diagnóstico de fallas o la verificación de configuraciones críticas. En contextos donde la continuidad operativa y la interacción segura con sistemas reales son determinantes, este tipo de evolución podría convertir a MCP en una base especialmente valiosa para construir soluciones de mayor alcance.

Nuestra experiencia muestra que el valor de MCP no está únicamente en automatizar tareas puntuales, sino en hacer posible una participación más contextualizada, controlada y útil de la IA a lo largo de varias etapas del desarrollo. Por ello, más que pensar en esta tecnología como una promesa futura, el siguiente paso para las organizaciones debería ser identificar en qué procesos puede generar valor desde hoy, comenzar con pilotos controlados y construir, de forma progresiva, una adopción alineada con sus herramientas, sus equipos y sus objetivos de negocio.